Primeras herramientas de Inteligencia Artificial para el entrenamiento auditivo

La Inteligencia Artificial (IA) despierta infinidad de expectativas en múltiples ámbitos y, en este caso, ya promete revolucionar aspectos como el entrenamiento auditivo o la evaluación cognitiva, además del procesamiento de ‘Big Data‘, la detección precoz, el diagnóstico o la intervención logopédica

Como principal aplicación de estas nuevas tecnologías de IA, se presenta ya de entrada del procesamiento de datos. Tal como subrayó la audióloga y logopeda Pilar San Martín, de CCEE HUA Osakidetza Vitoria, durante su participación en las últimas jornadas de audiología pediátrica organizada por OirT en Málaga, el ‘Big Data’ es el «combustible» de la IA, así como la Medicina Basada en la Eficiencia MBE. La dinámica se orienta a un ecosistema de Big Data y los Sistemas integrados HL7 (Health Level Seven).

Imagen del dispositivo Hearfit, con asiento.

(Fuente: HEARFIT)

Esta especialista apuntó también al «riesgo de brecha entre sistemas públicos y privados de salud» y abogó para evitarlo por «coordinar recursos y esfuerzos». Entre sus conclusiones, auguró que la IA «no va a sustituir a los profesionales sanitarios, sino que es un aliado», en definitiva, «una tecnología añadida en los dispositivos audioprotésicos para reducir la brecha entre deseo de adquirir y la necesidad de rehabilitar la hipoacusia».

De forma cronológica por la edad, su aprovechamiento tiene potencial para unificar los programas de cribado, tanto para realizar un mejor seguimiento de casos con CMV (citomegalovirus), las pérdidas auditivas de inicio tardío y, en general, el trabajo interdisciplinar. Incluso puede formular hipótesis para la investigación y reducir la tasa de abandonos de los dispositivos para la audición.

«La IA se perfila, sobre todo, como una herramienta capaz de aprender y analizar con rapidez enormes cantidades de información de los historiales de pacientes y de las pruebas clínicas realizadas, para ofrecer mejores diagnósticos y tratamientos», resumió. De hecho, cuando en los hospitales piden un equipo de electromedicina, ya exigen que esté integrado en los sistemas de recopilación de datos del centro.

San Martín también se ha referido al aprovechamiento de este tipo de tecnologías para el estudio de audiometrías, además de mencionar que se empiezan a utilizar herramientas como las app Audcal (avalada por SEORL), Tinnibot (tinnitus) y HearWHO (de medición de la audición, auspiciada por la OMS, la Organización Mundial de la Salud). Para logopedia, hay pocas opciones por ahora, sí está HARVI (un sistema de rehabilitacion auditiva en entornos difíciles mediante escucha virtual), iniciativa que ha surgido de un grupo de familias de niños con hipoacusia en Navarra (EUNATE).

Evaluación cognitiva

Hay tres herramientas de IA que permiten el entrenamiento auditivo ligado en cierta manera a la evaluación cognitiva, presentadas por el presidente del Colegio Nacional de Audioprotesistas (CNA) de Francia, Matthieu del Rio, quien expuso su funcionamiento en el último congreso de la Asociación Nacional de Audioprotesistas (ANA), en Madrid.

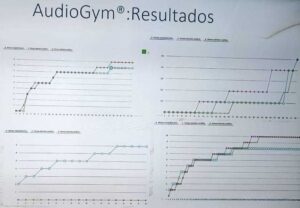

AudioGym plantea tres tipos de ejercicios (de comprensión en silencio-ruido-confusión; de atención auditiva y de memoria auditiva -auditivo-verbal y doble tarea-), además de propiciar que el paciente mejore su capacidad de atención y se libere de estrés. El profesional puede diseñar con él estrategias de escucha, se presenta de entrada como un «complemento» a las sesiones de logopedia y favorece la corrección de los problemas de confusión fonética, cuando en ciertos ambientes ruidosos, otros sonidos perturban el entendimiento verbal según las frecuencias afectadas por la hipoacusia de la persona.

Pantallas contenidas en el método Cognifit.

(Fuente: Cognifit)

Sus resultados han quedado demostrados en dos estudios de laboratorio, uno en entorno ruidoso y con usuarios de implante coclear, en una tesis de Lloret G., y también se ha medido una mejora estadísticamente significativa de 1,94 dB del SIB-50 en el test VRB, en este caso con una tesina de fin de carrera de P. Rivet. Se puede acceder gratuitamente on-line, si bien en su web no aparece la opción de cambiar de idioma y únicamente se ve en francés.

El protocolo Cognifit parte de un cuestionario que abarca el estado de ánimo, el bienestar físico, psicológico y social, a continuación se define un «perfil cognitivo» mediante una batería de tareas para evaluar los principales factores neuropsicológicos identificados en la literatura científica, en forma de «divertidos juegos interactivos de fácil comprensión para las personas mayores», tal como describió Del Rio.

Consta de siete tests (tocar, nombrar, rango de números…) para analizar tres factores, a saber: la memoria (a corto plazo, visual, memoria de trabajo), la coordinación (capacidad de realizar movimientos ordenados, verificación de la agilidad) y el razonamiento (capacidad del cerebro para procesar la información). Con esta caracterización del perfil desde esta vertiente cognitiva, se puede mejorar la detección precoz de trastornos que perturban la rehabilitación auditiva, al evitar que se vuelvan crónicos o también al permitir que se inicie el tratamiento lo antes posibles. Resulta especialmente práctico con personas que tienen tendencia a perder la memoria o falta de atención.

App hearWHO de la Organización Mundial de la Salud (OMS).

(Fuente: WHO)

La batería de evaluación cognitiva automatizada (CAB-AG) para mayores de 65 años -que dura entre 13 y 16 minutos- evalúa el estado actual de las capacidades cognitivas relacionadas con el envejecimiento y es útil si presenta pérdida de memoria, de atención o de capacidades cognitivas relacionadas. Además, Del Rio aseguró que todas las pruebas están patentadas y avalados por varios estudios científicos, y en su web se puede elegir la versión en castellano para probar los «juegos diseñados por psicólogos para disfrutar mientras se entrenan las habilidades cognitivas».

En cuanto a Hearfit, se presenta en dos modalidades, con un sillón o en versión «mini» portátil, concebidas ambas como un «entrenamiento auditivo» que simula tanto entornos sonoros en silencio o con ruido de fondo, a partir de ejercicios. La empresa ofrece el servicio de equipamiento para el centro auditivo, aunque no se precisa si hay versión en otros idiomas o si dan soporte a clientes de países aparte de en Francia.

Gráfico de resultados de una prueba con AudioGym, expuesto por Mathieu del Río en último congreso de la ANA. (Fuente: Mathieu del Río)

Destacan la posibilidad de adaptación a la carta y a medida para cada usuario, siempre toda estrategia encaminada a mejorar su comprensión del habla. También, «un verdadero aislamiento fónico y un sonido binaural para un confort de escucha». El sistema Hearfit ha conseguido un eco mediático tras su lanzamiento y Del Rio destacó durante su presentación en el congreso de la ANA que permite operar en un entorno sonoro «calibrado y reproducible», además de favorecer «un nivel de confort satisfactorio para las personas mayores».

Como idea interesante igualmente, hay un artículo de marzo de 2017 de Jessica J. M. Monaghan et al. acerca de ‘Las técnicas de aprendizajes automáticos inspiradas en la audición pueden mejorar la inteligibilidad y la calidad del habla de los oyentes con déficit auditivo’, que da pie a pensar en el potencial de la IA para la eliminación del ruido de fondo y en el que se realizó una evaluación del rendimiento de cuatro algoritmos en términos de intelibilidad y calidad sonora.

El conferenciante francés abundó en esta línea de la supresión del ruido aludiendo a otro artículo Ying-Hui Lasi et al. centrado en la ‘Mejora del rendimiento de los audífonos en entornos ruidosos basado en la tecnología de Deep Learning‘, con la conclusión de que ese tipo de sistemas puede utilizarse, efectivamente, para avanzar en la inteligibilidad y la calidad del habla en usuarios de estos dispositivos. Ese ‘aprendizaje en profundidad’ va a dar un salto cualitativo con el tratamiento de la información (Big Data) basado en situaciones auditivas reales (MM):

Para la audiometría tonal

Otro campo de trabajo para la IA se sitúa en la audiometría tonal, donde hasta ahora, en su modalidad «clásica», realiza una estimación «discreta» de frecuencia, se desarrolla de forma «manual, ineficaz y lenta», además de «monopolizar un tiempo clínico valioso», según el severo análisis del presidente del CNA francés.

Audcal.

También existen los «protocolos de audiometría automatizada«, que sólo coinciden en ese primer objetivo (estimación «discreta» de frecuencia), mientras que ofrecen una «secuencia de presentaciones de sonido objetivo predecibles» y si su precisión no es la adecuada resultan «incompatibles con el uso clínico en términos temporales».

Frente a esto, el principio de la audiometría tonal mediante IA se lleva a cabo con una fase de inicio en la que proporciona «una estimación rápida del umbral auditivo y el paciente escucha diferentes frecuencias e intensidades» y se consigue finalmente un ‘active learning’ (aprendizaje activo), ya que «se conoce la incertidumbre para cada uno de los puntos de la parrilla», además de que la siguiente prueba de sonido (frecuencia por intensidad) se determina «para reducir lo más rápidamente posible la incertidumbre en la estimación del límite liminar o umbral».

Del Rio ha detallado que este punto debe determinarse próximo al umbral (estimado a partir de las respuestas anteriores) y debe estar asociado a un nivel de incertidumbre elevado (relativamente alejado de los puntos acabados).

El aporte clínico de la Inteligencia Artificial en esta prueba se resume como sigue:

-Diez minutos ahorrados por paciente (lo que mejora el acceso a la atención sanitaria y permite atender a más personas, además de favorecer la prevención).

-Alta precisión, percepción y repetibilidad (mejora así el diagnóstico y la gestión de los pacientes, aparte de garantizar la eficacia y los más altos estándares de calidad y seguridad).

–Proceso automatizado (con un control de toda la cadena organizativa o tecnológica y una mejora de los conocimientos científicos para permitir una mejor comprensión de los trastornos auditivos).

Y, como conclusión general, Del Rio resaltó que «la IA está revolucionando el concepto y el uso de los audífonos«, dado que «los resultados positivos de la investigación muestran que tiene la capacidad de mejorar la vida de las personas con pérdida de audición al ofrecer una mejor calidad de sonido y una experiencia auditiva más personalizada». Eso sí, apeló a continuar investigando de forma «constante» con el fin de «superar los retos actuales y maximizar los beneficios de la IA en el ámbito de los audífonos».

App audiológicas

Igualmente para la audiometría tonal, los usuarios de iPhone disponen de la app Audcal, que representa gráficamente los resultados y permite realizar cálculos con estos datos. Da la opción de introducir la información de la prueba audiológica realizada previamente o utilizar su sintetizador de tonos puros.

App Tinnibot.

Otra aplicación para móvil es Tinnibot, que ofrece terapias e incluso conversación con un «compañero» de IA para convivir con el tinnitus. Sus creadores prometen que emplea «técnicas clínicamente probadas», mediante sonidos relajantes. En este caso, está disponible también para Android, no sólo para el sistema operativo iOS.

Incluso la Organización Mundial de la Salud (OMS) ha lanzado una app (hearWHO) en varios idiomas (chino, neerlandés, inglés, ruso y español) para favorecer la detección precoz de la pérdida de audición, ya que es «crucial» para su rehabilitación eficaz. «Todas las personas deben revisar su audición de vez en cuando, especialmente aquellas que corren un mayor riesgo de padecerla, quienes suelen escuchar música alta, trabajan en lugares ruidosos, utilizan medicamentos perjudiciales para la audición o tienen más de 60 años», divulgan desde la web de esta aplicación.

La aplicación hearWHO se basa en una tecnología de dígitos en ruido validada y permite acceder a un evaluador auditivo para comprobar el estado de audición y realizar un seguimiento a lo largo del tiempo, con las mediciones registradas.

Acceso socio

Acceso socio